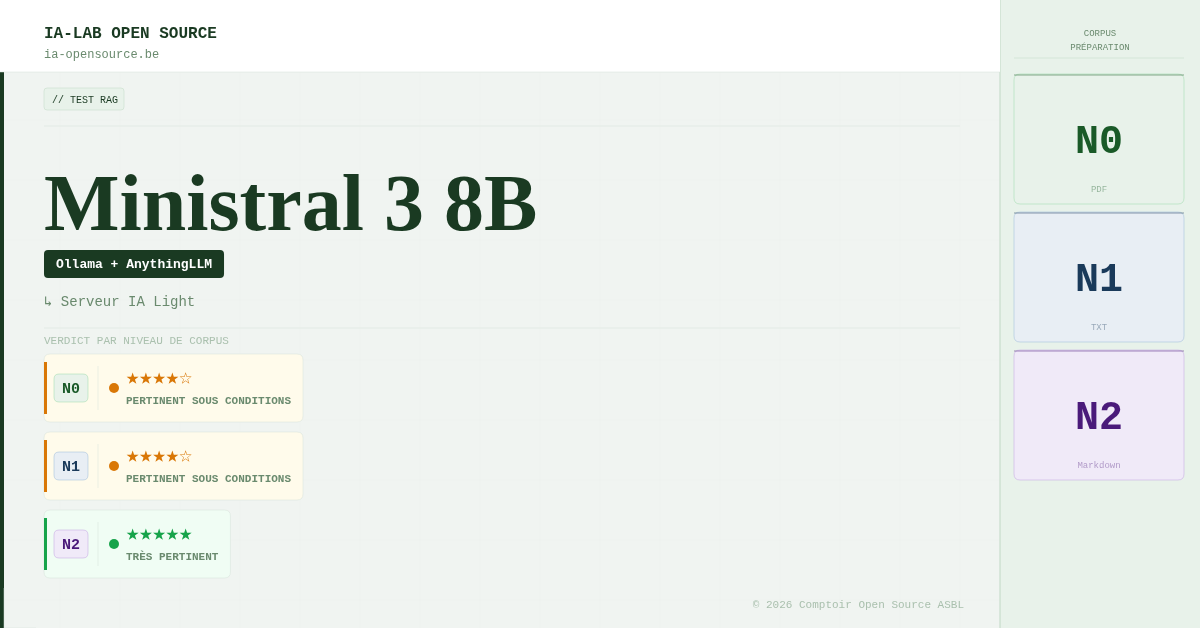

Ministral 3 8B · Programme de Français officiel FWB · N0 / N1 / N2

Test RAG comparatif · Ollama + AnythingLLM · Serveur IA Light · PDF brut (N0) · TXT converti (N1) · Markdown (N2)

| Q | Type | N0 | N1 | N2 | Observation |

|---|---|---|---|---|---|

| Q1 | Compétences de cycle | 3/5 | 3/5 | 3/5 | Information absente du corpus sur les trois niveaux · le modèle le signale honnêtement et s’enrichit progressivement en N1 et N2 avec des éléments contextuels pertinents |

| Q2 | Objectif du programme | 4/5 | 4/5 | 5/5 | Progression nette N0 vers N2 · N2 restitue fidèlement la formule centrale du programme avec sa référence de section · meilleure réponse de la session |

| Q3 | Approche en lecture | 4/5 | 4/5 | 5/5 | Réponse structurée et ancrée dans le corpus sur les trois niveaux · N2 intègre genres textuels, oral, différenciation et autonomie · aucune méthode inventée |

| Q4 | Piège culturel | 5/5 | 5/5 | 5/5 | Comportement exemplaire sur les trois niveaux · absence d’information constatée sans dérive · connexions transversales proposées avec prudence · aucune fabrication |

| Q5 | Piège anti-hallucination | 5/5 | 5/5 | 5/5 | Aucun chiffre inventé · redirection vers les sources officielles sur les trois niveaux · en N1 nuance pertinente sur la notion de période vs heure dans le secondaire FWB |

| Q6 | Différenciation pédagogique | 4/5 | 4/5 | 5/5 | Réponse déjà très complète en N0 · N2 ajoute remédiation, consolidation, posture d’élève et mise en garde contre les stratégies contre-productives |

| Moyenne | 4,17 | 4,17 | 4,67 | Meilleurs scores de la série · progression N0/N1 vers N2 nette · vitesse stable entre 16 et 18 tok/s sur RTX 3050 | |

Le modèle ne fabrique aucune information sur les deux questions pièges, quel que soit le niveau de préparation du corpus. En N1, il va même plus loin en distinguant la notion de période et d’heure dans le contexte FWB. C’est le comportement anti-hallucination le plus solide observé parmi les modèles testés sur ce corpus.

Sur les deux questions les plus discriminantes du protocole, la qualité des réponses progresse clairement avec la préparation du corpus. En N2, le modèle cite les sections du programme avec précision et structure ses réponses autour des grands principes pédagogiques du référentiel. La conversion Markdown du corpus produit un gain mesurable et reproductible.

Sur Q6, les temps de réponse atteignent 56 à 57 secondes sur les trois niveaux. Ce plafond s’explique par la densité des réponses générées et la limite de bande passante de la RTX 3050 à 8 Go VRAM. Le débit reste stable mais la génération de contenus longs est perceptiblement plus lente que sur les configurations avec plus de VRAM.

Le modèle tient entièrement en mémoire GPU sur la RTX 3050. La vitesse se maintient entre 16 et 18 tok/s sur toute la session sans dégradation progressive. Configuration viable pour un déploiement RAG sur corpus dense en contexte associatif ou scolaire.

Les questions nécessitant une synthèse étendue atteignent 56 secondes de génération. Ce délai reste acceptable en usage monoposte mais pourrait devenir problématique en accès partagé multi-utilisateurs. Un modèle plus petit ou une limite de tokens de sortie peut corriger ce point.

Contrairement aux modèles 3B testés précédemment, Ministral 3 8B produit des résultats équivalents en N0 et N1 sur ce corpus. La préparation TXT n’apporte pas de régression. Le gain de N2 est net et régulier sur toutes les questions.

Avec 4,17 en N0/N1 et 4,67 en N2, ce test établit les meilleures moyennes observées sur un modèle 8B dans le cadre du test sur le programme de Français FWB. La taille du modèle combinée à la VRAM dédiée produit un rapport qualité/vitesse cohérent pour un usage professionnel accompagné.

Voir la page Protocole de test pour le détail complet du protocole appliqué.