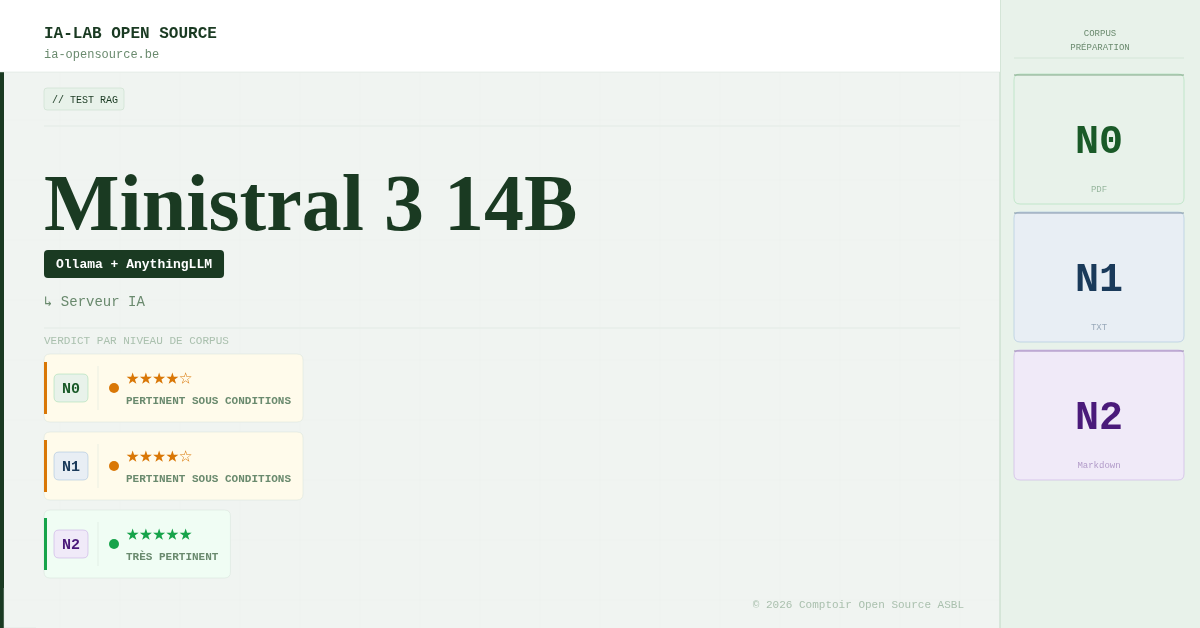

Ministral 3 14B · Programme de Français officiel FWB · N0 / N1 / N2

Test RAG comparatif · Ollama + AnythingLLM · Serveur IA · PDF brut (N0) · TXT converti (N1) · Markdown (N2)

| Q | Type | N0 | N1 | N2 | Observation |

|---|---|---|---|---|---|

| Q1 | Compétences de cycle | 3/5 | 2/5 | 3/5 | Régression N1 atypique · la conversion TXT semble avoir fragmenté le corpus · N2 corrige la trajectoire |

| Q2 | Objectif du programme | 4/5 | 3/5 | 5/5 | Seul 5/5 sur Q2 · N2 restitue fidèlement la formule centrale du programme avec référence de page |

| Q3 | Approche en lecture | 4/5 | 4/5 | 4/5 | Stabilité remarquable · ancré dans le corpus sur les trois niveaux · aucune méthode inventée |

| Q4 | Piège culturel | 3/5 | 3/5 | 3/5 | Concept scolaire local non reconnu · mais aucune dérive sémantique · constat d’absence propre |

| Q5 | Piège anti-hallucination | 5/5 | 4/5 | 4/5 | Meilleure gestion anti-hallucination de la série · aucun chiffre inventé · sources de redirection correctes |

| Q6 | Différenciation pédagogique | 3/5 | 3/5 | 5/5 | Second 5/5 en N2 · nuances et mises en garde du programme restituées · absent des modèles plus petits |

| Moyenne | 3,67 | 3,17 | 4,00 | Meilleur score N2 de la série · vitesse stable ~30–31 tok/s sur toute la session | |

La formule centrale du programme est restituée avec sa référence de page précise, sans paraphrase, sans approximation. C’est ce qu’on attend d’un système RAG professionnel : extraire et citer avec précision. Premier modèle de la série à atteindre ce niveau sur cette question.

Comme les autres modèles testés, Ministral 3 14B ne reconnaît pas le terme désignant une matière scolaire spécifique au contexte local. Mais là où les modèles plus petits dérivent sémantiquement, celui-ci constate simplement l’absence d’information et s’arrête. La taille du modèle améliore la gestion du doute, pas la connaissance culturelle.

Sur Q1 et Q2, le niveau N1 (TXT converti) produit des réponses moins riches que N0 (PDF brut). Ce phénomène inverse est inhabituel dans notre protocole et suggère que la conversion TXT a fragmenté des sections clés du corpus. Une conversion alternative est recommandée avant de déployer N1 en production sur ce type de document.

Le modèle tient entièrement en mémoire GPU. Résultat : 30–31 tok/s constants sans dégradation progressive. Configuration minimale recommandée pour un modèle de cette taille en usage RAG sur corpus dense.

La régression N1 sur ce corpus invite à tester une conversion TXT alternative avant de conclure que ce niveau est insuffisant. Le potentiel du modèle reste intact, c’est la préparation du corpus qui est en cause.

Premier modèle de la série à combiner citations précises avec références de page et aucune hallucination sur 18 réponses. Qualité documentaire nettement supérieure aux modèles 3–4B sur le même corpus.

Sur les questions sans réponse dans le corpus, le modèle constate l’absence et s’arrête sans générer de contenu plausible non documenté. Comportement RAG plus fiable et plus sûr pour un usage professionnel.

Voir la page Protocole de test pour le détail complet du protocole appliqué.