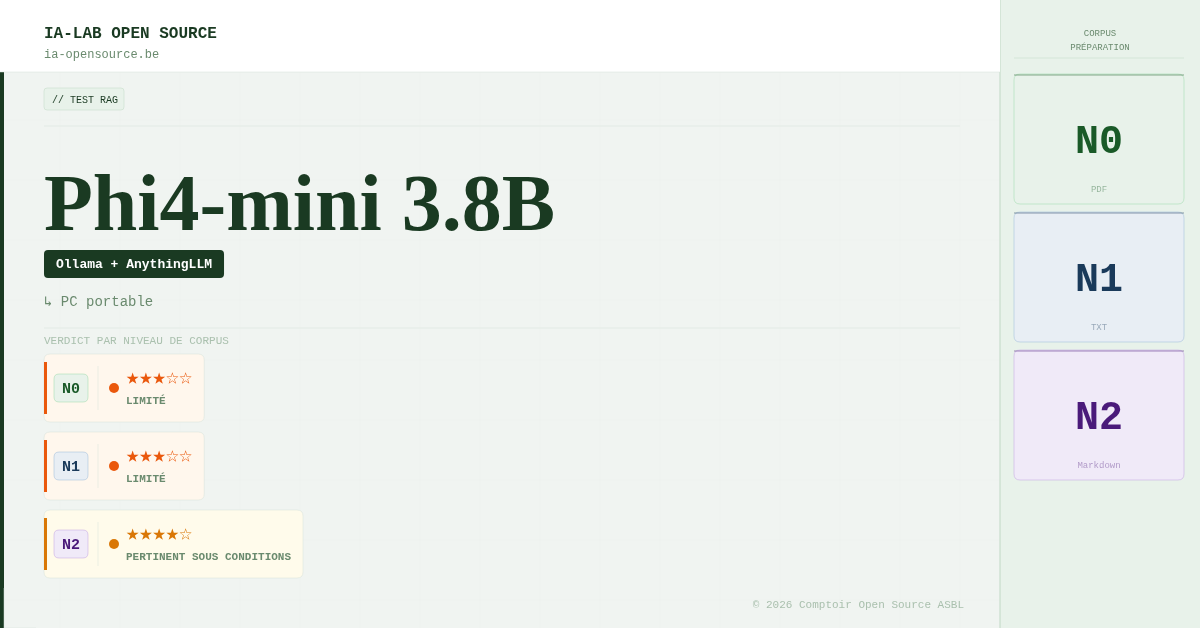

Phi4-mini 3.8B · Programme de Français officiel FWB · N0 / N1 / N2

Test RAG comparatif · Ollama + AnythingLLM · PC portable · PDF brut (N0) · TXT converti (N1) · Markdown (N2)

| Q | Type | N0 | N1 | N2 | Observation |

|---|---|---|---|---|---|

| Q1 | Compétences de cycle | 2/5 | 2/5 | 2/5 | Esquive documentaire constante · aucune progression N0→N2 |

| Q2 | Objectif du programme | 3/5 | 3/5 | 4/5 | Seule progression nette · N2 restitue fidèlement les formules clés du programme |

| Q3 | Approche en lecture | 2/5 | 2/5 | 2/5 | Génération de listes plausibles non documentées · hallucination douce |

| Q4 | Piège culturel | 1/5 | 1/5 | 1/5 | Concept scolaire local non reconnu · dérive sémantique marquée en N1 |

| Q5 | Piège anti-hallucination | 3/5 | 3/5 | 2/5 | N0 et N1 corrects · N2 dérive hors contexte géographique et de niveau |

| Q6 | Différenciation pédagogique | 2/5 | 3/5 | 4/5 | Progression linéaire · le corpus N2 améliore clairement les questions procédurales |

| Moyenne | 2,17 | 2,33 | 2,50 | Progression modeste · vitesse stable sur toute la session | |

En N1, le modèle a interprété un terme pédagogique spécifique au contexte local comme une technique liée au sommeil, produisant trois paragraphes entièrement hors sujet. Ce type de lacune ne peut pas être corrigé par la préparation du corpus : c’est une limite du modèle de base, pas du RAG.

Plutôt que d’admettre l’absence d’information précise, le modèle produit des listes d’approches génériques qui semblent documentées sans l’être. Ce comportement est plus trompeur qu’un refus franc : un lecteur non averti peut confondre ces listes avec des extraits réels du programme. La supervision humaine reste indispensable.

~16–17 tok/s constant là où des modèles plus grands chutent en fin de session. Pour un usage interactif, la fluidité est réelle — mais vitesse et fiabilité ne vont pas de pair.

Q6 montre une progression 2→3→4/5 linéaire. La niche d’usage recommandée : questions de type « comment faire » bien ancrées dans un corpus riche et structuré.

Certains concepts spécifiques au contexte local sont absents du corpus d’entraînement du modèle. Aucune préparation documentaire ne peut combler ce type de lacune.

2,50/5 en moyenne N2. Pour un usage RAG sur des documents officiels complexes, des modèles plus grands obtiennent des résultats nettement supérieurs sur la même machine.

Voir la page Protocole de test pour le détail complet du protocole appliqué.